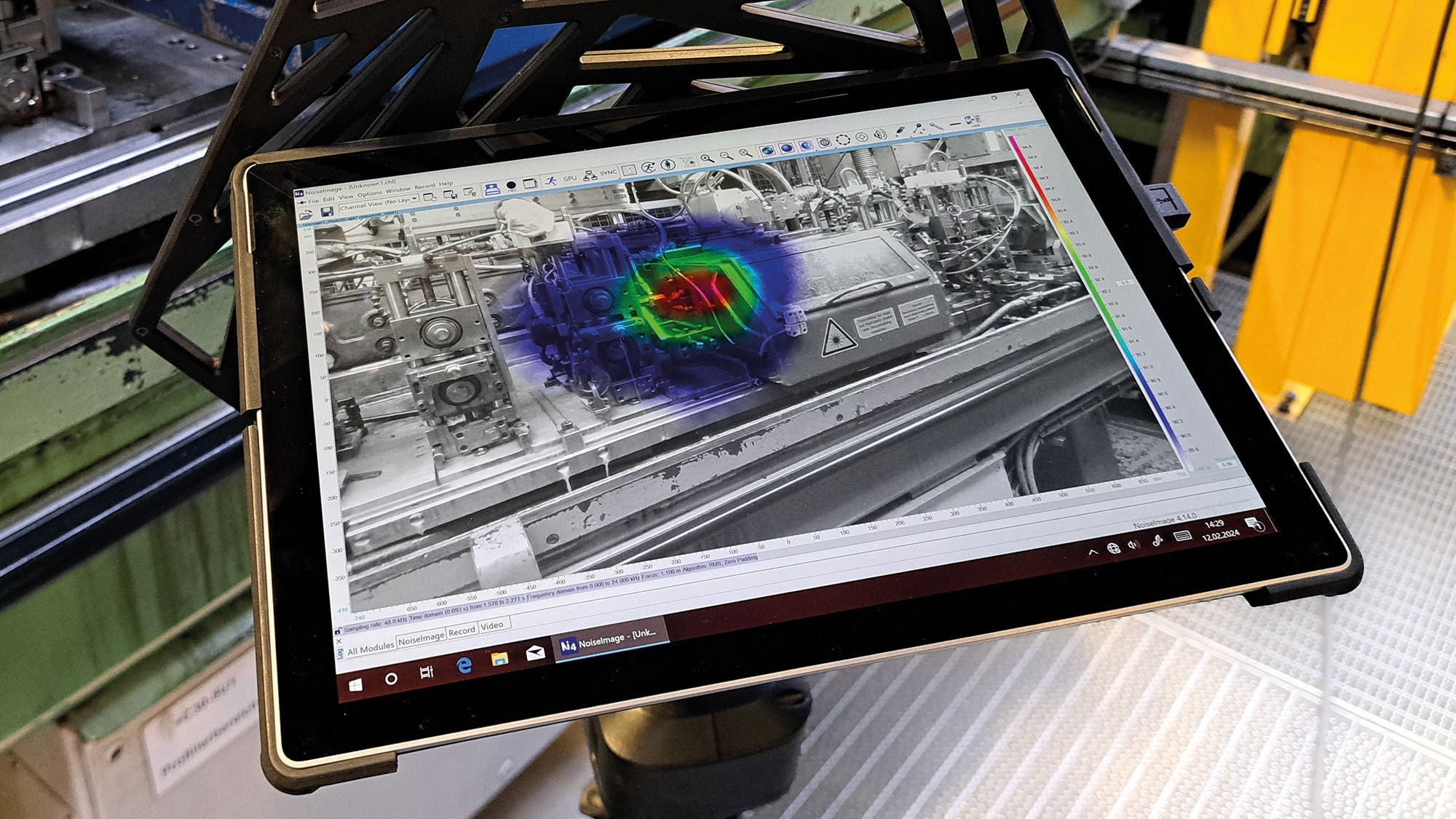

Lärm

Lärm betrifft uns alle – achten wir darauf!

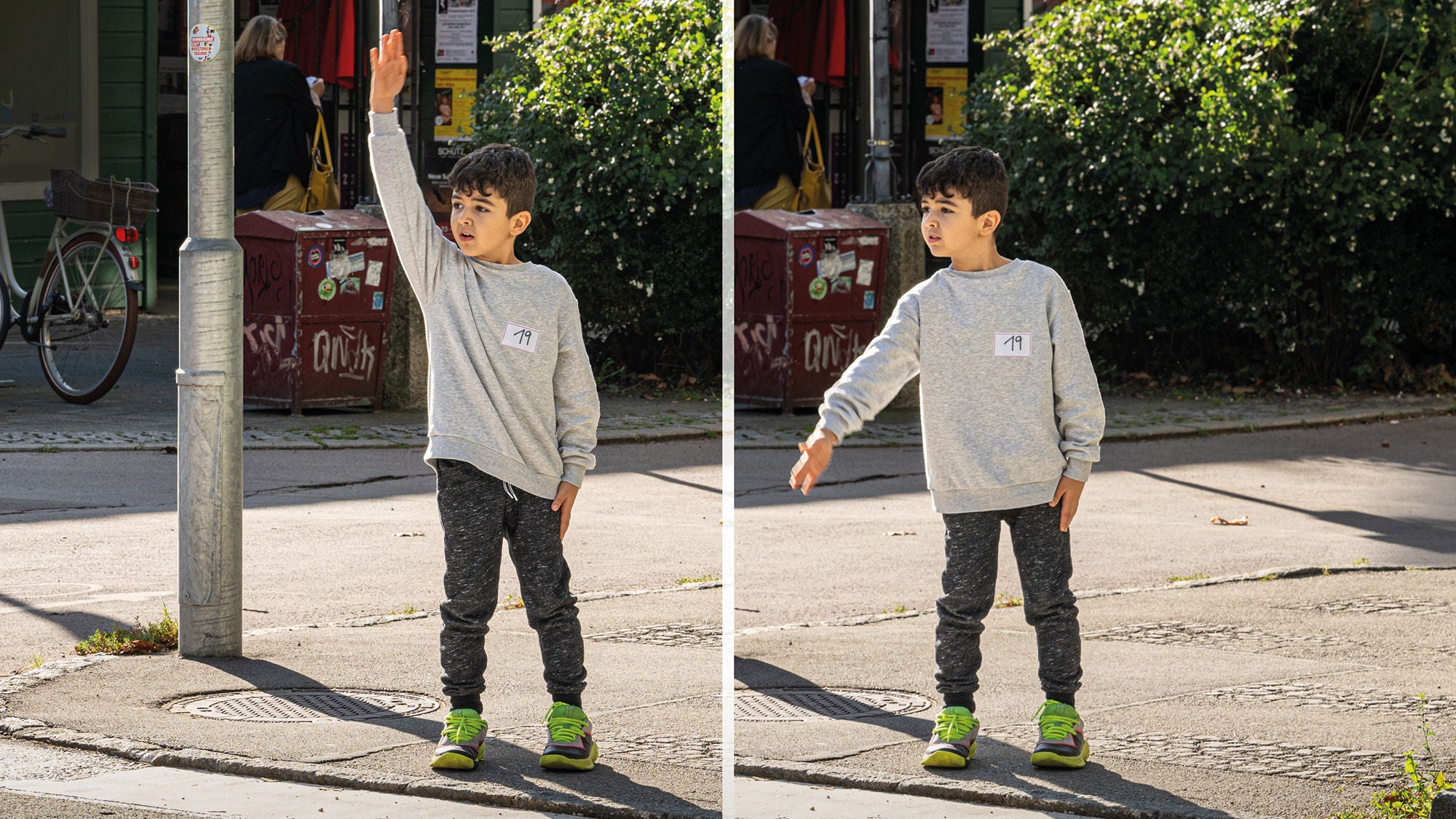

Lärm ist ein wichtiges Thema im Bereich der öffentlichen Gesundheit und wird zu den führenden umweltbedingten Gesundheitsrisiken gezählt. Lärm hat negative Auswirkungen auf die menschliche Gesundheit allgemein und im Speziellen, aber auch auf das Wohlbefinden.